به گزارش خبرنگاران علم و فناوری گزارش خبر، اپل روز گذشته اعلام کرد در آمریکا سیستمی را برای کنترل تصاویر آیفونها قبل از آپلود شدن در آی کلود راه اندازی میکند تا تضمین شود آنها با عکسهای شناخته شده کودک آزاری مطابقت ندارند.

ردیابی آپلود تصاویر کودک آزاری برای محافظت در برابر ردیابی اشتباه تصاویر غیرقانونی کارآمد است و به بازبینی محتوا توسط انسان و گزارش کاربر به نیروی مجری قانون منجر میشود.

این شرکت ادعا میکند سیستم را طوری طراحی کرده تا تعداد تصاویری که به اشتباه کودک آزاری تلقی میشود، به یک در یک هزار میلیارد عکس کاهش یابد.

سیستم جدید اپل در پاسخ به در خواست مجریان قانون برای ریشه یابی آزار کودکان و با توجه به حفظ حریم خصوصی و امنیت افراد ایجاد شده است. البته برخی حامیان حریم خصوصی معتقدند چنین سیستمی مسیر را برای ردیابی محتوای سیاسی یا غیره در آیفون باز میکند.

این درحالی است که بسیاری از شرکتهای بزرگ فناوری دیگر از جمله گوگل، فیس بوک و مایکروسافت تصاویر کاربران را با مخزنی از تصاویر کودک آزاری مقایسه و کنترل میکنند.

شیوه کارکرد سیستم اپل به این گونه است؛ مقامات پلیس مخزنی از تصاویر کودک آزاری شناخته شده را در اختیار دارند که آنها را به کدهای عددی (hash) تبدیل میکنند تا شناسایی شوند. اما نمیتوان از این کدها برای بازسازی تصاویر استفاده کرد.

اپل با استفاده از فناوری به نام Neural Hash مخزن تصاویر مجریان قانون از کودک آزاری را اجرا کرده است. دیگر هدف از این اقدام ردیابی تصاویر ادیت شده و مشابه نمونههای اصلی است. این مخزن روی آیفونها ذخیره میشود.

هنگامیکه کاربری تصویری را در آی کلود ذخیره میکند آیفون یک کد عددی از تصویر میسازد تا آن را با مخزن داده مذکور مقایسه کند.

تصاویر ذخیره شده در آیفون فرد کنترل نمیشود و بازبینی محتوا توسط کارمند انسانی قبل از اطلاع به پلیس برای تضمین صحت فرایند قبل از تعلیق حساب کاربری فرد است.

به گفته اپل کاربرانی که احساس کنند حساب کاربری آنها بدون دلیل تعلیق شده میتوانند به این امر اعتراض کنند.

ردیابی فرد کودکآزار با راهکار جدید اپل!

اپل برای کمک به نیروهای مجری قانون و ردیابی تصاویر کودک آزاری قابلیت جدیدی را راهاندازی میکند که عکسها را قبل از آپلود شدن در آیکلود بررسی می کند.

اشتراک گذاری:

لینک کوتاه

- برچسبها:

- آی کلود

- آیفون

- اپل

- ردیابی کودک آزاری

- کودک آزاری

ارسال نظر

نظر دهید

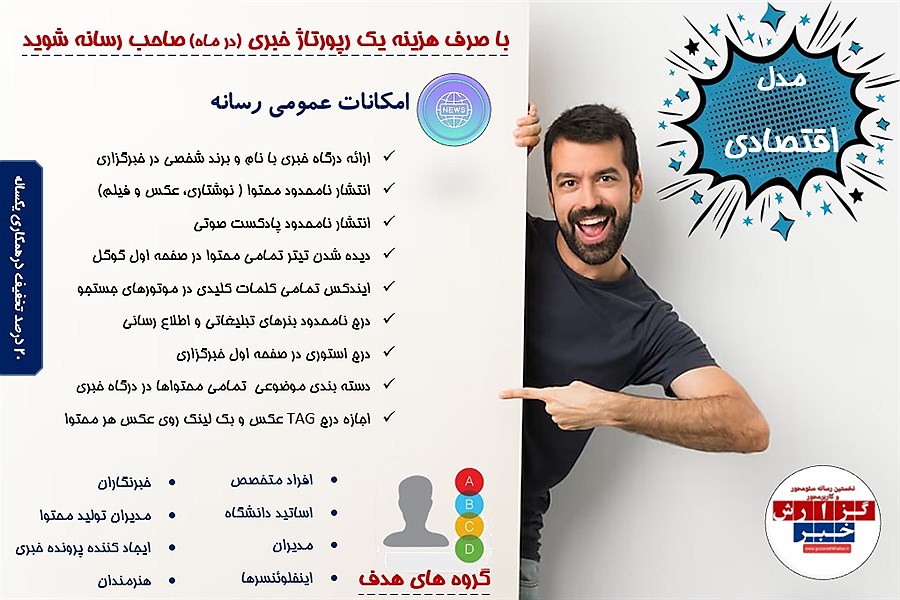

مدل VIP

پایگاه خبریت را راه بنداز

مدل سازمانی

با دستیار روابط عمومی صاحب رسانه شوید

فرودگاه ها و ناوبری هوایی ایران

ایجاد زیرساخت و ارائه خدمات فرودگاهی و ناوبری هوایی ایمن، کارآمد و اقتصادی در کشور

صنایع معدنی نوظهور کویر بافق

اشتغالزایی پایدار، ارزش آفرینی مواد معدنی و تأمین مواد اولیه صنعت فولاد کشور

مدل اقتصادی

پروفایل خبریت را راه بنداز